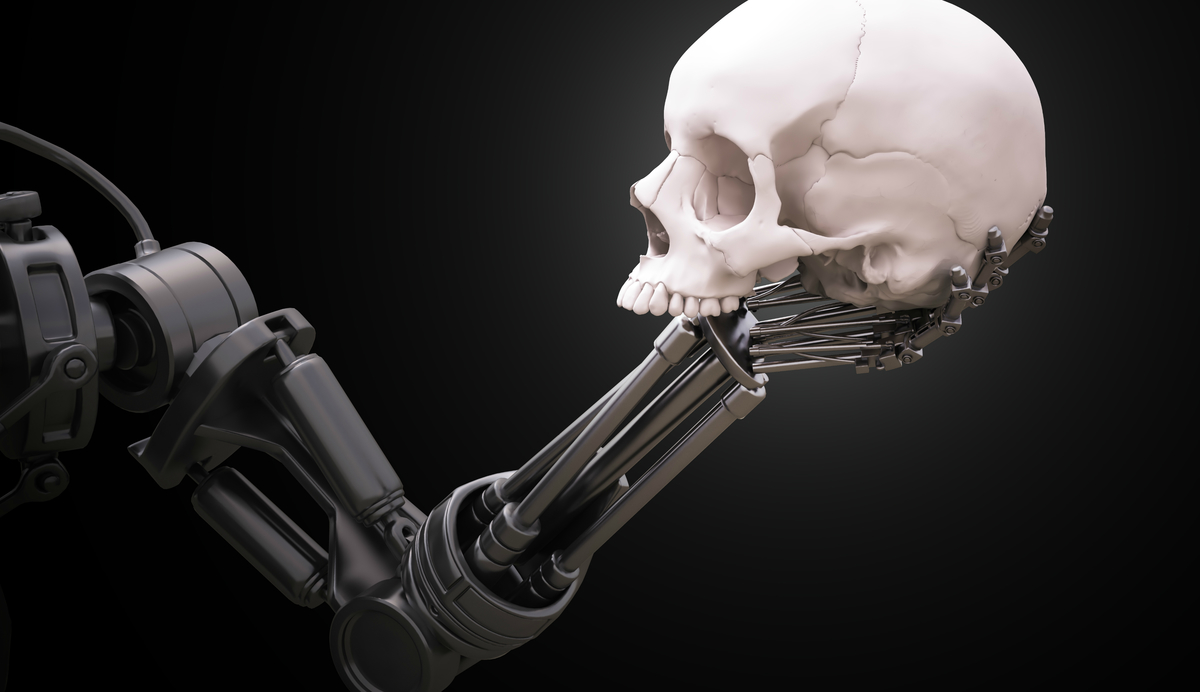

Singularité inversée : quand la stupidité artificielle esclavagise l’homme automate

Le nombre d’articles, d’émissions, d’essais, de débats, de conférences sur l’intelligence artificielle est en croissance exponentielle. Tout le monde veut donner son avis sur les IA ou savoir si elles deviendront "conscientes d’elles-mêmes", auront une "intelligence supérieure" à celle de l’homme, et si l’humanité — au final — pourrait être mise en danger, voire détruite par ces dernières.

Vous lisez un article réservé aux abonnés.

Le nombre d’articles, d’émissions, d’essais, de débats, de conférences sur l’intelligence artificielle est en croissance exponentielle. Tout le monde veut donner son avis sur les IA ou savoir si elles deviendront "conscientes d’elles-mêmes", auront une "intelligence supérieure" à celle de l’homme, et si l’humanité — au final — pourrait être mise en danger, voire détruite par ces dernières. Ce qui est fantastique dans cet emballement autour des IA (et du concept de "singularité technologique"), avec les pro, les anti, les inquiets ou les optimistes, c’est que personne ou presque ne pose les bonnes questions. Ni ne veut regarder vraiment le concept de l’IA (forte ou non) pour ce qu’il est : une "nouvelle" économie, continuation logique et incontournable de l’économie du numérique, et l’aboutissement des politiques hypercapitalistes des 30 dernières années. Avec, en toile de fond, un phénomène qui œuvre en faveur du développement des IA à tous les niveaux de la société : la transformation des individus des sociétés développées en "automates humains", producteurs-consommateurs inconscients de leur sort, à "l’intelligence" de plus en plus formatée et dont l’imaginaire, généré massivement par l’industrie, se rapproche de plus en plus de celui qu’on pourrait attribuer à une machine. Capacités ultra-performantes de la stupidité artificielle (SA)

Ce qui est nommé intelligence artificielle n’est rien d’autre qu’une...